Guide de l'IA générative en 2026 : entre puissance cloud et confidentialité

90 % des entreprises exposent leurs données aux IA publiques. Panorama des solutions cloud, agrégateurs, local-first, et l'approche hybride d'Elosia.

1. Le paradoxe de l’IA en 2026

Le constat : une dépendance croissante, avec des risques immenses

En 2026, l’intelligence artificielle n’est plus une tendance, c’est devenu l’outil de travail incontournable dans les organisations. Selon une étude de Celiveo, 90 % des entreprises exposent chaque jour leurs données aux modèles d’IA publics via les comptes personnels de leurs salariés, souvent à leur insu. En parallèle, les violations de données liées aux LLM ont connu une trajectoire inquiétante : les incidents de sécurité IA ont explosé de 50 % en un an selon DeepDive, tandis que le coût moyen mondial d’une violation de données atteint désormais 4,88 millions de dollars en 2024, en hausse de 10 % par rapport à 2023.

Ce chiffre n’est que le début. L’IA générative crée une nouvelle classe de menaces : le « Shadow AI ». Vos données d’entraînement alimentent les modèles futurs. Vos prompts stratégiques s’accumulent sur des serveurs hors UE. Vos conversations confidentielles risquent l’injection de prompts ou la réutilisation non autorisée. Alors que nous n’avons jamais eu accès à des outils aussi puissants, nous n’avons jamais couru autant de risques.

Peut-on vraiment faire confiance aux géants du cloud ?

La question posée par des milliers de DPO et responsables IT est existentielle en 2026 : Peut-on utiliser GPT-5, Claude 4.5 ou Gemini 3 Pro sans compromettre nos données stratégiques ?

La réponse, selon les autorités de régulation, est nuancée. OpenAI a certes amélioré sa conformité RGPD depuis 2023 en proposant des DPA et des offres Enterprise. Mais plus de 60 % des données transmises à ChatGPT contiennent des informations personnelles identifiables, et seuls 20 % des utilisateurs connaissent les paramètres de confidentialité. Pire encore, les versions gratuite et payantes hors entreprises restent non conformes au RGPD, avec conservation illimitée et transparence insuffisante.

En parallèle, l’IA Act de l’Union européenne impose une « analyse d’impact sur les droits fondamentaux » dès 2026 pour tous les systèmes IA à haut risque, avec des amendes pouvant atteindre 7 % du chiffre d’affaires annuel. Le message est donc clair : la responsabilité incombe à l’entreprise, pas au fournisseur de cloud.

Ce que cet article couvre

- Comprendre les risques réels posés par les géants du cloud et le « Shadow AI »

- Explorer les outils hybrides qui tentent de réconcilier puissance et sécurité

- Découvrir l’approche local-first avec Ollama et AnythingLLM

- Évaluer Elosia.ai, la plateforme qui promet une « troisième voie » entre sécurité totale et puissance multi-modèle

- Choisir la stack IA la plus adaptée à vos risques et votre contexte réglementaire

2. Les géants du cloud : OpenAI, Anthropic, Google, puissance brute et risques stratégiques

Modèles de nouvelle génération et écosystèmes intégrés

En janvier 2026, les trois leaders mondiaux offrent des capacités impressionnantes :

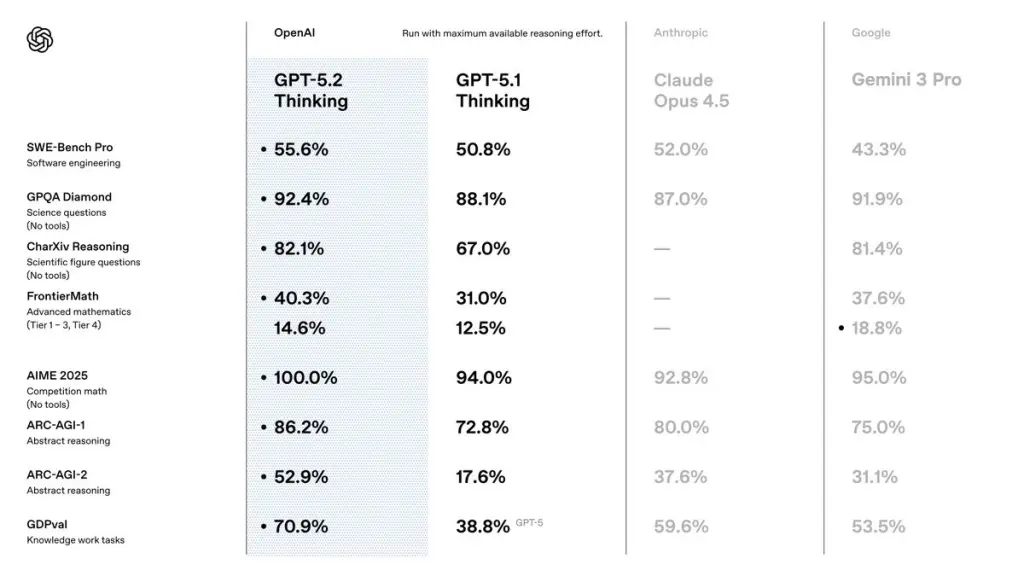

GPT-5.2 (OpenAI) : nouveau modèle unifié avec raisonnement adaptatif. Performance exceptionnelle en mathématiques (100 % sur AIME 2025 sans outils), réduction de 45 % des hallucinations avec web search activé, et vitesse améliorée grâce au routing intelligent. Context window de 400 000 tokens.

Claude Opus 4.5 (Anthropic) : leader incontesté en codage (80,9 % sur SWE-bench Verified). Context window de 200 000 tokens compensé par une mémoire persistante entre sessions. Forces particulières dans les tâches complexes multi-étapes et la « Computer Use » la capacité à interagir directement avec un ordinateur.

Gemini 3 Pro (Google) : modèle multimodal natif avec context window géante (1 million de tokens ≈ 750 000 mots). Intégration transparente avec Google Workspace. Deep Think mode pour raisonnement approfondi. Score Elo de 1501, premier à dépasser 1500.

Bien qu’offrant une puissance sans équivalent, ces modèles posent une question importante : qu’en est-il de la confidentialité ?

Le problème central : le « Shadow AI »

Trois risques convergent en 2026.

1. Entraînement continu et récupération de données

OpenAI, Anthropic et Google, par défaut (à moins d’accord Enterprise), utilisent vos données pour améliorer leurs futurs modèles. Cette pratique pose deux risques majeurs :

- Vol de propriété intellectuelle : une stratégie commerciale confidentielle, un rapport d’audit client, un code propriétaire tout ce que vous copiez-collez dans un LLM public devient potentiellement du training data.

- Exposition involontaire : un salarié écrit « Notre client X a un budget de 10 M€ en 2026 » ? Cette phrase rejoint les datasets d’entraînement. Un autre LLM pourrait reproduire cette information.

2. Stockage hors UE et problématique RGPD persistante

Malgré des améliorations, les serveurs d’OpenAI, Anthropic et Google sont majoritairement localisés aux États-Unis. Sous le RGPD, les transferts de données hors UE nécessitent une base légale robuste. Or, la jurisprudence Schrems II (juillet 2020) a invalidé le Privacy Shield et compliqué les SCCs/CCT.

Conséquence en 2026 : 63 % des données ChatGPT contiennent des infos permettant d’identifier les utilisateurs. Et aux yeux de la loi européenne, vous restez responsable de la conformité, pas le fournisseur.

3. Fuites par injection de prompts et logs serveurs

Une nouvelle classe de cyberattaques émerge : l’injection de prompts. Un attaquant insère des instructions cachées dans des données que le modèle doit traiter, forçant le LLM à divulguer des informations sensibles du contexte précédent. Plus votre historique de prompts s’accumule, plus le risque augmente.

Tableau synthétique : forces vs. risques

| Critère | GPT 5.2 | Claude 4.5 | Gemini 3 Pro |

|---|---|---|---|

| Puissance mathématique | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Performance de code | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Multimodal | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Context window | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Conformité RGPD | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

| Confidentialité par défaut | ⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

Conclusion : ces modèles sont exceptionnels. Mais sans contrôles supplémentaires, ils ne conviennent pas aux données stratégiques ou soumises au RGPD sans négociation contractuelle stricte.

3. L’approche multi-modèle : les agrégateurs WritingMate et Mammouth.ai

L’intérêt : éviter le vendor lock-in

La tendance 2026 va vers les agrégateurs multi-modèles. WritingMate et Mammouth.ai promettent de centraliser GPT-5, Claude, Gemini, Mistral et autres dans une interface unique.

Avantages :

- Flexibilité : un texte argumenté ? Claude. Générer une image ? Gemini. Faire des maths complexes ? GPT-5.2. Accéder au meilleur sans multiplier les abonnements.

- Réduction des coûts : un seul abonnement Mammouth.ai (à partir de 10-60 €/mois) remplace trois ou quatre souscriptions individuelles.

- Continuité du travail : historique centralisé, projets organisés, friction réduite.

- Assurance contre les changements de modèle : si un LLM se dégrade, basculer sur un autre prend quelques clics.

Comparatif rapide : WritingMate vs. Mammouth.ai

WritingMate : positionnement premium, fort sur la rédaction. Extension Chrome puissante, intégration directe dans Gmail, Docs. Stockage cloud standard avec quelques garanties, mais pas de Zero Data Retention natif (ZDR). Excellent pour les équipes marketing et rédaction. Tarification : ~20-60 €/mois.

Mammouth.ai : approche plus ambitieuse, plateforme centralisée complète. Accès à 20+ modèles, analyse de documents, génération d’images, voix/dictée, recherche web intégrée. Interface parfois complexe pour les débutants, mais riche pour les power users. Tarification : 10 € (basique) à 60 €/mois (premium). Rapport polyvalence/prix excellent.

La limite : ces outils restent uniquement des agrégateurs

WritingMate et Mammouth.ai ne résolvent pas le problème de confidentialité.

Ces plateformes facilitent l’accès aux LLM, mais vos données transitent quand même par les serveurs des géants du cloud (OpenAI, Anthropic, Google). Mammouth.ai ajoute une couche d’abstraction, pas une barrière de confidentialité. Bien que le mode ZDR soit parfois utilisé, les données restent stockées sur un serveur cloud et sont donc vulnérables aux attaques.

La question du Zero Data Retention (ZDR) n’est pas au cœur de leur architecture. ZDR signifie que vos données sont traitées en mémoire puis immédiatement détruites, jamais stockées, jamais entraînées.

4. Le local-first : Ollama et AnythingLLM sécurité absolue pour un coût technique élevé

Ollama : le standard pour les modèles locaux

Ollama est devenu en 2025-2026 l’outil de référence pour faire tourner des LLM sur votre machine personnelle.

- Vous téléchargez un modèle open-source (Llama 3, Mistral, Code Llama).

- Vous l’exécutez localement sur votre ordinateur (CPU ou GPU).

- Aucune donnée ne quitte votre machine.

Forces

- Sécurité 100 % privée : vos données ne quittent jamais votre ordinateur.

- Coût marginal après installation : aucun abonnement mensuel.

- Propriété totale : transparence des modèles open-source.

Faiblesses

- Puissance informatique requise : Llama 3 70B requiert 64+ GB de RAM et idéalement un GPU puissant (RTX 4090, H100).

- Latence : 2-5 secondes par prompt simple au lieu de millisecondes.

- Performance inférieure : gap estimé de 25-35 % vs Claude Opus 4.5 ou GPT-5.2.

- Maintenance continue : drivers GPU, mises à jour, dépannage.

AnythingLLM : l’interface parfaite pour RAG local

AnythingLLM transforme Ollama d’outil technique en véritable plateforme de travail. Cas d’usage : ingérer 100 contrats clients en PDF, vectoriser localement, interroger en langage naturel tout en local.

Cas réels en 2025-2026 :

- Due diligence : analyser des rapports d’acquisition.

- Support client : répondre à partir de la base de connaissances interne.

- Recherche juridique : interroger une base de contrats sans risque RGPD.

- Onboarding : former un salarié via questions sur la documentation interne.

La meilleure configuration : Ollama (serveur LLM) + AnythingLLM (interface RAG) = sécurité totale en 5 minutes.

Le compromis : sécurité ++ mais puissance limitée

| Critères | Local (Ollama / AnythingLLM) | Cloud (Claude/GPT/Gemini) |

|---|---|---|

| Sécurité des données | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Conformité RGPD | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Puissance brute | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Vitesse | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Coûts opérationnels | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Maintenance | ⭐⭐ | ⭐⭐⭐⭐⭐ |

Verdict : Ollama + AnythingLLM est excellent pour les données ultra-sensibles et les équipes avec ressources IT. Pour tous les autres, c’est un compromis plus douloureux entre sécurité et productivité.

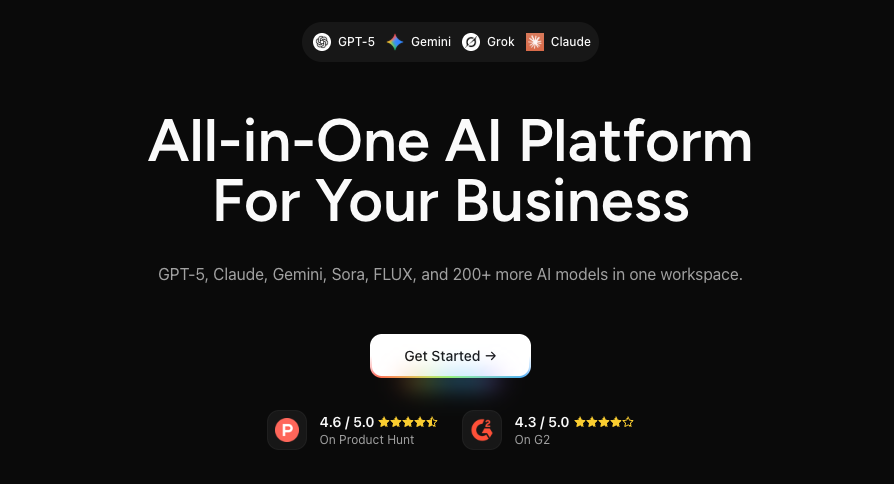

5. Elosia.ai : la synthèse multi-modèle + Zero Data Retention + Browser-First

Le positionnement : réconcilier des mondes irréconciliables

Elosia.ai émerge en 2026 avec une promesse audacieuse : accédez aux meilleurs modèles mondiaux (GPT, Claude, Mistral) dans une interface sécurisée, garantissant techniquement qu’aucune donnée n’est stockée chez les fournisseurs.

C’est la « troisième voie » entre trois impasses :

- ❌ Géants du cloud : puissance maximale, données vulnérables.

- ❌ Agrégateurs classiques : flexibilité, ZDR absent ou stockage serveur.

- ❌ Local-first : sécurité totale, puissance limitée et complexité technique.

Elosia combine les avantages des trois.

Pilier 1 : accès multi-modèle natif

Contrairement aux agrégateurs, Elosia n’est pas une simple couche d’abstraction. L’architecture est pensée pour la diversité de modèles dès la conception : GPT-5.2, Claude Opus 4.5, Gemini 3 Pro, Mistral, Llama 3. Chaque modèle reste accessible directement, sans « dégradation de signal ». Tout en étant transparent sur la politique des données du modèle.

Pilier 2 : le bouclier ZDR (Zero Data Retention)

Elosia garantit techniquement (pas seulement contractuellement) qu’aucune donnée n’est stockée chez les fournisseurs de modèles.

- Traitement éphémère : données en mémoire pendant le traitement, effacées immédiatement après réponse.

- Accord ZDR contractuel avec les principaux providers, accessible à tout moment pour la transparence.

- Stockage local : toutes les données sauvegardées dans un compartiment sécurisé du navigateur.

- Pas de logs persistants : Elosia n’archive que les métadonnées (timestamps, modèles utilisés), jamais les prompts ou réponses.

Impact pratique : vous pouvez utiliser Claude 4.5 sur des contrats clients sensibles sans violer le RGPD, car il n’existe aucun log persistant chez Anthropic.

Pilier 3 : innovation Browser-First (WebGPU)

Le troisième pilier distingue Elosia : capacité d’exécuter des modèles directement dans le navigateur via WebGPU.

- Exécution locale de petits modèles : certains prompts n’ont pas besoin de Claude. Un petit modèle tourne dans votre navigateur, zéro envoi cloud.

- Hybridation intelligente : tous les messages sont vectorisés localement pour fournir un contexte pertinent sans envoyer la totalité des informations au LLM.

- Confidentialité sans friction : pas besoin d’installer Ollama ou de GPU sur machine. Tout fonctionne via le navigateur en mode offline.

Avantages cumulatifs d’Elosia

- Puissance des géants cloud + ZDR contractuel

- Interface unifiée sans friction cognitive

- Sécurité par design

- Conformité RGPD native

- Pas de maintenance IT

- Hybride local + cloud = performances optimales

6. Conclusion : quelle stack IA choisir pour votre entreprise en 2026 ?

| Matrice | Cloud-First | Agrégateur | Local-First | Elosia |

|---|---|---|---|---|

| Sécurité des données | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Facilité d’usage | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| Coût mensuel moyen | 20 - 200 € | 10 - 80 € | 0 € | 20 - 60 € |

| Conformité RGPD | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Puissance moyenne | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Fonctionnalités | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

Recommandations par profil

Startup / PME sans données sensibles → cloud pur (GPT-5 + Cursor pour code)

- Justification : coûts réduits, pas de friction, équipe réduite.

- Cas concret : agence marketing, studio créatif.

Entreprise avec données clients sensibles → Elosia.ai

- Justification : ZDR + puissance + conformité native.

- Cas concret : cabinet juridique, cabinet comptable, agence web avec clients régulés.

Groupe Tech avec ressources IT → Ollama + AnythingLLM (local) + Claude API (cloud)

- Justification : sécurité maximale sur données ultra-sensibles, cloud pour tâches non-confidentielles.

- Cas concret : éditeur logiciel, agence IA, consulting stratégique.

Équipe décentralisée nécessitant flexibilité → Mammouth.ai

- Justification : rapport polyvalence/prix, pas de complication IT.

Le contexte réglementaire 2026

- 1,15 milliard d’euros d’amendes RGPD en 2025 pour violations de conformité.

- 7 % du CA possible pour non-conformité AI Act (dès 2026 pour systèmes à haut risque).

- Article 32 RGPD renforcé : obligation de sécurité renforcée pour données IA.

- Privacy by Default devenant Privacy by Design.

Le message est clair : le coût de l’imprudence dépasse largement celui d’une stack sécurisée.

Checklist finale

Avant de changer de solution, posez-vous ces questions :

- Avez-vous un DPA (Data Processing Addendum) signé avec votre fournisseur IA ?

- Vos données transitent-elles en dehors de l’UE ?

- Disposez-vous d’une garantie ZDR contractuelle ou technique ?

- Votre fournisseur IA forme-t-il ses modèles sur vos données ?

- Avez-vous documenté une AIPD (Analyse d’Impact Protection des Données) pour chaque système IA ?

- Vos salariés ont-ils reçu une formation sur les risques de Shadow AI ?

- Disposez-vous d’une politique de Shadow IT ?

- Votre assurance cyber couvre-t-elle les brèches IA ?

Si 3+ réponses sont « non », votre stack présente un risque.